RGPD et IA : comment exploiter vos données sans jamais les exposer

Protéger les données personnelles tout en exploitant pleinement l’intelligence artificielle devient un enjeu critique pour toutes les organisations. La pseudonymisation des données IA et l’anonymisation ne sont plus des sujets réservés aux juristes ou aux data-scientists : elles conditionnent votre capacité à entraîner des modèles, à utiliser des agents IA métiers et à rester conforme au RGPD. Dans ce guide pratique, découvrez comment choisir entre pseudonymisation et anonymisation, quelles techniques employer et comment les intégrer dans un workflow IA réellement sécurisé.

Pseudonymisation et anonymisation des données pour l’IA : guide pratique

Temps de lecture : ~9 min

- Sommaire

- Comprendre pseudonymisation et anonymisation en contexte IA

- Mettre en place un workflow de pseudonymisation des données IA sécurisé

- Techniques concrètes selon le type de données

- À faire et à ne pas faire pour sécuriser vos données IA

- Questions fréquentes sur la pseudonymisation des données IA

- Conclusion

1 Comprendre pseudonymisation et anonymisation dans un contexte IA

1.1 Définition de la pseudonymisation

La pseudonymisation remplace les identifiants personnels directs (nom, prénom, adresse mail, numéro de téléphone, identifiant client) par des pseudonymes ou des codes. Exemple : « Jean Dupont » devient « CLIENT A ». La réidentification reste possible grâce à la clé ou à la table de correspondance conservée séparément ; pour le RGPD, il s’agit donc toujours de données personnelles.

Conséquences : vous devez disposer d’une base légale, maintenir les droits des personnes et appliquer des mesures de sécurité fortes. Pour l’IA, la pseudonymisation préserve la structure et la richesse des données, permettant aux modèles d’apprendre sur des comportements proches de la réalité.

1.2 Définition de l’anonymisation

L’anonymisation rend toute réidentification impossible en supprimant ou en modifiant de façon irréversible les éléments identifiants. Elle peut passer par la suppression de colonnes, la généralisation (date complète → année) ou le brouillage de valeurs via des données synthétiques. Une fois anonymisées, les données sortent du champ du RGPD ; c’est idéal pour l’open data, la recherche ou les cas d’usage où l’identité réelle ne doit jamais être retrouvée.

1.3 Quand choisir pseudonymisation ou anonymisation

Si vous devez suivre un dossier individuel, appliquer un droit d’accès ou corriger une information (relation client, parcours patient, suivi salarié), la pseudonymisation est le bon choix, accompagnée d’une gestion rigoureuse de la clé de réidentification.

Si vous souhaitez partager des données à des tiers, publier des jeux de données ou limiter au maximum les risques de fuite, l’anonymisation ou les données synthétiques sont préférables. Dans nombre de projets IA, on combine : pseudonymisation pour le travail interne, anonymisation ou données synthétiques pour la diffusion externe.

2 Mettre en place un workflow sécurisé de pseudonymisation des données IA

2.1 Étape 1 : auditer les données sensibles

Commencez par recenser les bases utilisées pour l’entraînement, les champs contenant des données personnelles directes ou indirectes et les données envoyées aux LLM, agents métiers ou services externes. N’oubliez pas les combinaisons permettant la réidentification par inférence, par exemple « date de naissance + code postal + profession ».

2.2 Étape 2 : choisir la bonne méthode technique

| Catégorie | Méthode | Description |

|---|---|---|

| Pseudonymisation | Règles texte | Expressions régulières pour remplacer mails, numéros et identifiants. |

| Pseudonymisation | IA supervisée | Modèle entraîné sur des annotations pour masquer automatiquement noms, adresses ou numéros. |

| Pseudonymisation | Techniques cryptographiques | Chiffrement ou tokenisation pour remplacer un identifiant par un jeton réversible via un service sécurisé. |

| Anonymisation | Suppression / masquage | Retrait complet des champs non nécessaires ou remplacement par des caractères neutres. |

| Anonymisation | Randomisation / permutation | Brassage de valeurs (ex. dates) pour brouiller les liens individuels tout en conservant la distribution. |

| Anonymisation | Généralisation | Réduction de précision : adresse → zone, date complète → année. |

| Anonymisation | Données synthétiques | Création d’enregistrements réalistes qui ne correspondent à aucune personne réelle. |

2.3 Étape 3 : intégrer la protection dans votre pipeline IA

1. Les données brutes arrivent de votre CRM ou SI.

2. Un module de pseudonymisation ou d’anonymisation les traite automatiquement.

3. Seules les données protégées sont envoyées aux modèles génératifs ou agents IA métiers.

4. Si besoin, la désanonymisation contrôlée s’effectue en environnement interne maîtrisé.

Une plateforme multi-modèles telle que Safebrain permet de placer ces filtres directement dans un scénario, puis de superviser les flux et les tokens consommés.

2.4 Étape 4 : tester utilité et risques

Testez, d’une part, la performance IA pour vérifier que la transformation ne dégrade pas les prédictions, et d’autre part, la possibilité de réidentification sur un échantillon, avec l’appui du DPO ou d’experts sécurité. Renforcez les techniques si la réidentification reste trop facile.

3 Techniques concrètes selon le type de données

3.1 Données tabulaires

Supprimez les colonnes inutiles (ex. numéro de pièce d’identité), pseudonymisez les identifiants directs (identifiant client, numéro de dossier), généralisez certaines variables sensibles (tranche d’âge plutôt que date exacte, secteur géographique plutôt qu’adresse complète), puis mesurez l’impact sur vos indicateurs IA et ajustez le niveau de précision.

3.2 Données textuelles libres

Commencez par un filtre de règles pour détecter mails, numéros de téléphone ou identifiants. Complétez avec un modèle IA supervisé de détection d’entités nommées sensibles et remplacez chaque entité par un pseudonyme cohérent (ex. PERSONNE A, ENTREPRISE 1). Conservez la table de correspondance dans un coffre-fort numérique distinct, jamais exposé aux services externes.

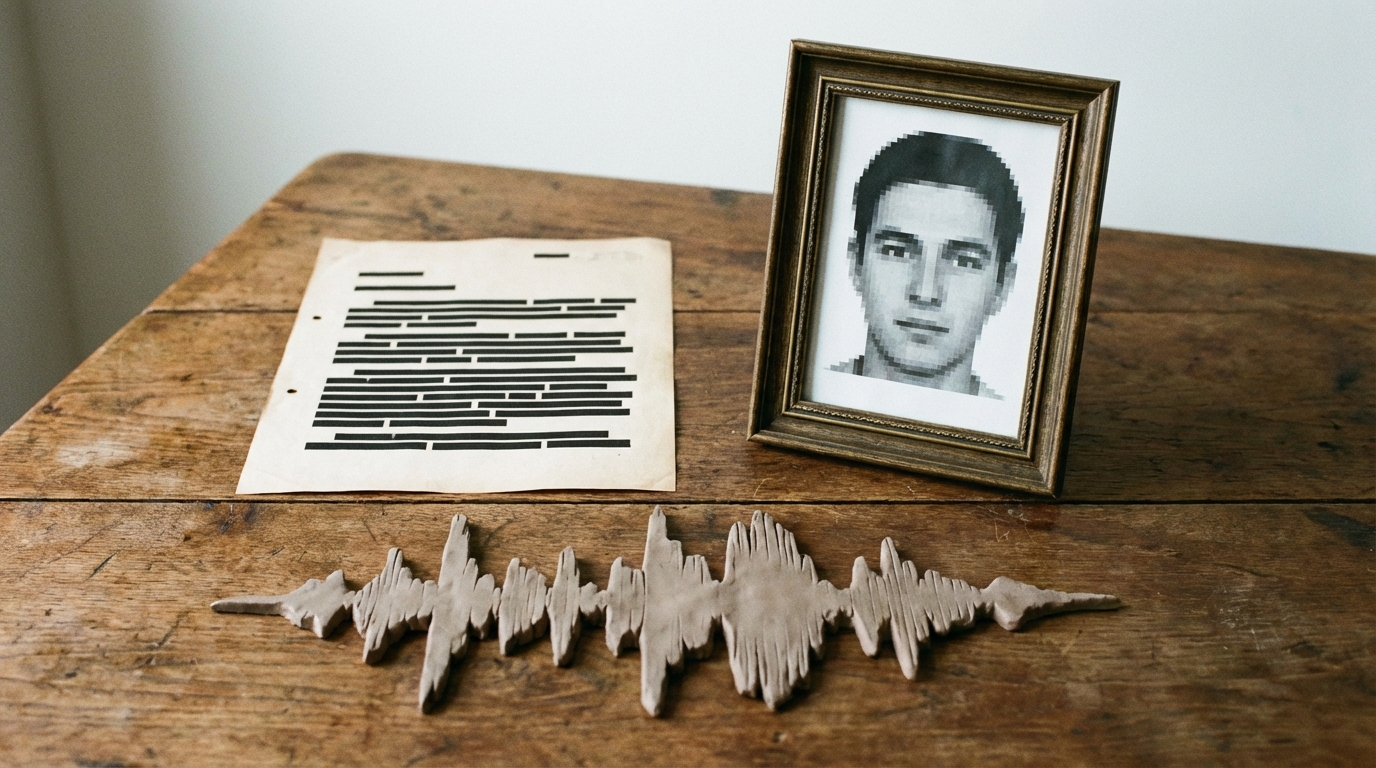

3.3 Données images ou audio

Floutez les visages ou plaques d’immatriculation sur images et vidéos, et masquez ou remplacez les noms propres et numéros dans les transcriptions audio. L’usage de modèles IA dédiés accélère ces traitements, sous réserve d’une validation humaine régulière.

4 À faire et à ne pas faire pour sécuriser vos données IA

| À faire | À ne pas faire |

|---|---|

| Documenter objectifs et catégories de données. | Envoyer des données brutes à un modèle externe, même pour un test. |

| Cartographier les flux du système source aux modèles IA. | Penser qu’en supprimant un nom on sort du RGPD. |

| Choisir la technique la plus simple couvrant le risque cible. | Réutiliser les mêmes pseudonymes sur plusieurs jeux de données. |

| Tester d’abord sur un petit échantillon avant déploiement. | Se reposer uniquement sur un outil sans validation humaine ou juridique. |

| Conserver la clé de réidentification dans un environnement chiffré et distinct. | Oublier d’informer utilisateurs et collaborateurs des mesures prises. |

| Mettre en place audits réguliers et journaux d’accès. |

5 Questions fréquentes sur la pseudonymisation des données IA

La pseudonymisation suffit-elle pour être conforme au RGPD ?

Non. La pseudonymisation est une mesure de sécurité forte, mais les données restent personnelles : vous devez disposer d’une base légale, informer les personnes, respecter leurs droits et limiter la durée de conservation.

L’anonymisation est-elle vraiment irréversible ?

En théorie oui, mais l’irréversibilité dépend de la qualité de la méthode et du contexte. Les autorités recommandent de combiner plusieurs techniques et d’évaluer régulièrement le risque de réidentification par inférence.

Les données synthétiques sont-elles la meilleure solution ?

Elles offrent un excellent compromis entre utilité statistique et protection de la vie privée, surtout pour l’IA. Elles nécessitent toutefois un travail initial de modélisation et de validation et ne remplacent pas toujours l’usage ponctuel de données réelles pour la calibration.

Peut-on utiliser des outils open source pour pseudonymiser ?

Oui. Il existe des modèles et guides open source pour la pseudonymisation de textes ou décisions publiques. Ils servent de base, mais doivent être adaptés à votre contexte métier et complétés par des contrôles spécifiques.

Comment une plateforme IA peut-elle aider à sécuriser mon workflow ?

Une plateforme multi-modèles comme Safebrain centralise les appels IA, crée des agents métiers préconfigurés, insère des étapes de pseudonymisation et d’anonymisation avant chaque appel, puis suit précisément les flux et les tokens consommés. Vous gagnez en contrôle, traçabilité et souveraineté sur vos usages IA.

Conclusion

En structurant votre workflow autour de la pseudonymisation et de l’anonymisation, vous profitez pleinement de l’IA tout en respectant vos obligations réglementaires et éthiques. Pour aller plus loin, découvrez nos solutions sur Safebrain.

Passionné par le numérique et grand amateur d'écriture qui apprécie tout particulièrement transmettre ses connaissances à d'autres personnes.