AI Act Européen – Tout comprendre pour être en conformité

Depuis le 1er août 2024, l’AI Act européen n’est plus un projet de texte mais une réalité qui se déploie progressivement dans toutes les entreprises qui utilisent l’intelligence artificielle. Que vous exploitiez un simple chatbot, un outil de lecture automatique de factures ou des algorithmes de scoring, vous êtes concerné. Cette nouvelle régulation ne vise pas à freiner l’innovation, mais à encadrer les risques et à protéger les droits fondamentaux. Comprendre l’AI Act dès maintenant est essentiel pour éviter les sanctions, mais aussi pour transformer vos usages de l’IA en avantage compétitif. Nous vous proposons un décryptage concret, centré sur les impacts pour votre organisation et sur la façon dont une plateforme comme SafeBrain peut vous aider à vous préparer.

L’AI Act européen est là. Votre entreprise est-elle prête ?

Temps de lecture : ~9 min

- Comprendre l’AI Act européen et ses grands objectifs

- Comment l’AI Act européen classe les usages de l’IA

- Quelles obligations concrètes pour votre entreprise

- Un calendrier d’application à anticiper dès maintenant

- Votre entreprise est-elle prête ? Les actions prioritaires

- Comment SafeBrain peut vous aider à intégrer l’AI Act dans vos usages

- Mini FAQ sur l’AI Act pour les entreprises

Comprendre l’AI Act européen et ses grands objectifs

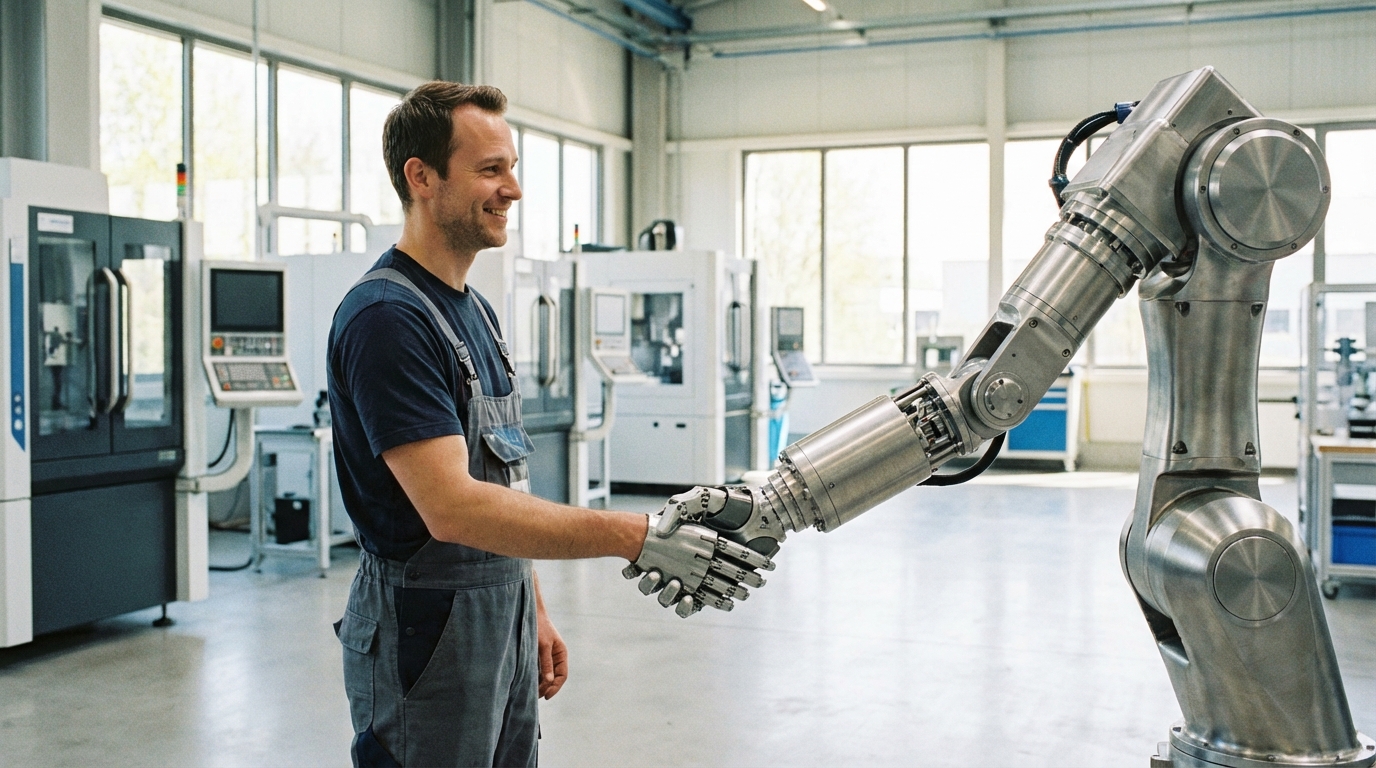

Un cadre européen pour une IA de confiance

L’AI Act européen est un règlement qui encadre la mise sur le marché et l’utilisation des systèmes d’intelligence artificielle dans l’Union européenne. Il poursuit deux objectifs : développer une IA centrée sur l’humain, digne de confiance, qui protège la santé, la sécurité, les droits fondamentaux et l’environnement ; soutenir l’innovation et la compétitivité grâce à un cadre harmonisé pour tous les acteurs.

Le texte ne se limite pas à interdire certains usages ; il fixe des règles communes sur ce qui est admis, interdit ou accepté sous conditions, en fonction des risques réels pour les personnes. Deux notions sont clés pour les entreprises : le règlement s’applique à la fois aux fournisseurs (ceux qui développent ou commercialisent des systèmes d’IA) et aux déployeurs (ceux qui les utilisent). Son application est progressive, avec des obligations dès février 2025 et une montée en puissance majeure en août 2026 pour les systèmes à haut risque.

Comment l’AI Act européen classe les usages de l’IA

Une approche fondée sur le niveau de risque

Le cœur de l’AI Act est une classification des systèmes d’IA en quatre niveaux de risque ; plus le risque est élevé pour la santé, la sécurité ou les droits fondamentaux, plus les obligations sont strictes.

| Niveau de risque | Exemples d’usages | Effets principaux pour l’entreprise |

|---|---|---|

| Inacceptable | Surveillance biométrique de masse, manipulation subliminale | Interdiction des pratiques concernées |

| Haut risque | Tri de CV, recrutement, scoring de crédit, systèmes de santé ou de sécurité | Exigences fortes : gestion des risques, qualité des données, supervision humaine… |

| Risque limité | Chatbots, assistants virtuels, IA générative, deepfakes | Obligation de transparence envers l’utilisateur |

| Risque minimal | Outils techniques sans impact notable | Aucune obligation spécifique (hors droit commun) |

Dans la plupart des organisations, les cas d’usage se situent surtout dans les catégories « risque limité » et « haut risque » ; un chatbot de relation client relève en général du risque limité, tandis qu’un système de tri de candidatures entre potentiellement dans la catégorie haut risque.

Quelles obligations concrètes pour votre entreprise

Côté déployeurs : les entreprises utilisatrices

Les déployeurs intègrent des systèmes d’IA dans leurs processus quotidiens. Même avec une solution tierce, vous avez des responsabilités propres si l’outil est utilisé dans l’Union européenne. Vous devez notamment inventorier vos IA, identifier leur niveau de risque, mettre en place une supervision humaine, documenter les usages, assurer la traçabilité via des journaux conservés au moins six mois, informer clairement les utilisateurs et gérer les incidents. Ces exigences s’ajoutent à celles du RGPD.

Côté fournisseurs : les développeurs et éditeurs

Les fournisseurs conçoivent, entraînent, testent et commercialisent des systèmes d’IA. Ils doivent veiller au respect des exigences du règlement selon le niveau de risque, obtenir un marquage CE pour les systèmes à haut risque, enregistrer certains modèles et fournir une documentation complète aux clients. Comprendre ces obligations aide aussi les déployeurs à choisir des partenaires transparents.

Un calendrier d’application à anticiper dès maintenant

Les grandes échéances de l’AI Act

- 1er août 2024 : entrée en vigueur du règlement (cadre général).

- 2 février 2025 : interdiction des pratiques à risque inacceptable et obligation de développer l’« AI literacy » dans les organisations.

- 2 août 2026 : obligations principales pour les systèmes à haut risque pleinement applicables (audit, documentation, supervision, suivi des risques).

- 2027 : règles spécifiques pour certains modèles d’IA à usage général, notamment les grands modèles de fondation.

Votre entreprise est-elle prête ? Les actions prioritaires

Trois actions prioritaires à lancer

- Auditer vos usages d’IA : identifiez tous les outils d’IA utilisés, décrivez le cas d’usage, les données traitées, le type de décision et l’impact potentiel.

- Renforcer la culture IA des équipes : formez non seulement les data scientists mais aussi les directions métiers, RH, managers et utilisateurs finaux.

- Documenter, tracer, monitorer : pour les systèmes à haut risque, soyez capables d’expliquer chaque décision, de suivre des métriques et de réagir en cas d’incident.

Comment SafeBrain peut vous aider à intégrer l’AI Act dans vos usages

Une plateforme pour orchestrer vos usages d’IA

SafeBrain propose une plateforme multi-LLMs qui permet de connecter et d’orchestrer plusieurs modèles d’IA de manière unifiée. Vous gardez le contrôle sur le choix des modèles, leur localisation et la gouvernance des données, ce qui facilite le respect du RGPD et de l’AI Act. Des agents IA prêts à l’emploi pour des cas métiers intègrent des garde-fous et des validations humaines compatibles avec le règlement. Un tableau de bord centralisé visualise les usages, les performances, les incidents et les ajustements. Le suivi des tokens d’utilisation contribue aux journaux nécessaires pour reconstituer les décisions a posteriori. Sur cette base, nous pouvons vous aider à structurer votre inventaire d’IA, paramétrer des workflows avec validation humaine et générer des rapports de conformité. Pour en savoir plus, visitez SafeBrain.

FAQ

Nous n’avons qu’un chatbot sur notre site, sommes-nous concernés ?

Oui. Même un chatbot peut relever du risque limité ; vous devez au minimum informer clairement les utilisateurs qu’ils interagissent avec une IA et gérer correctement les données personnelles (RGPD).

Que se passe-t-il si nous utilisons une solution IA d’un fournisseur non européen ?

L’AI Act s’applique dès lors que la solution est utilisée sur le marché européen. Vous restez responsable en tant que déployeur ; choisissez des fournisseurs capables de fournir la documentation et les garanties nécessaires.

Devons-nous tout mettre en conformité avant 2026 ?

Des obligations existent déjà (interdiction des pratiques à risque inacceptable, développement de la culture IA). Les exigences lourdes pour les systèmes à haut risque s’appliqueront à partir d’août 2026 ; commencez dès maintenant.

Quelle est la différence avec le RGPD ?

Le RGPD protège les données personnelles, quel que soit le système qui les traite. L’AI Act encadre spécifiquement les systèmes d’IA, y compris ceux qui traitent des données non personnelles. Les deux textes sont complémentaires.

Une PME est-elle autant concernée qu’un grand groupe ?

Oui, même si la mise en œuvre peut être proportionnée à la taille et aux ressources. Les obligations de base (transparence, supervision, documentation) concernent toute entreprise qui utilise l’IA dans ses processus.

En synthèse

L’AI Act européen marque un tournant : en abordant dès aujourd’hui vos usages d’IA avec une grille de lecture risques, supervision, traçabilité, vous serez à la fois conforme, plus transparent envers vos clients et plus compétitif à long terme.