IA en milieu hospitalier : entre révolution et risques cachés

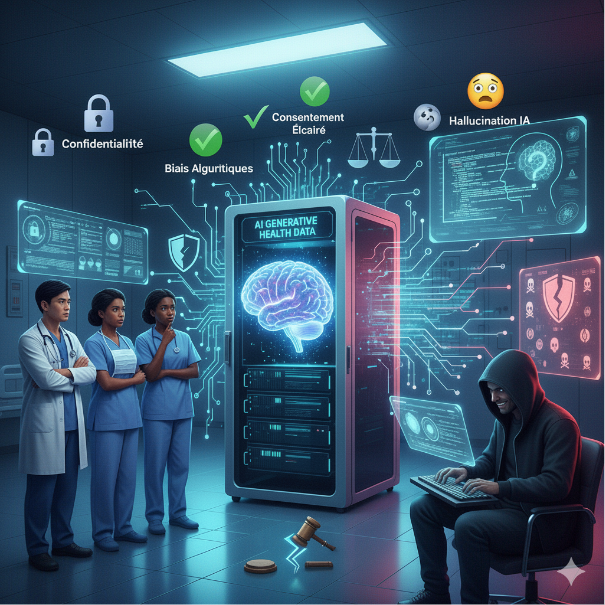

L’intelligence artificielle générative (IAg) s’invite dans le milieu hospitalier avec la promesse de révolutionner la gestion, le diagnostic et le traitement. Cependant, cette révolution ne se fait pas sans risques, surtout quand elle touche aux données les plus sensibles qui soient : celles de la santé.

Les professionnels des hôpitaux et des cliniques doivent être sensibilisés aux risques d’une mauvaise exploitation des données de santé par l’IA générative. Comprendre ces enjeux est la première étape pour une implémentation responsable et sécurisée de l’IA dans ces établissements.

Ce n’est donc pas un hasard si SafeBrain est de plus en plus adopté par les acteurs de la santé.

Enjeux et risques éthiques et juridiques

Confidentialité et anonymisation des données

Les modèles d’IA générative sont gourmands en données. Ils sont entraînés sur de vastes ensembles de données de santé, souvent dans le but de mieux comprendre les maladies et d’optimiser les traitements. Bien que ces données soient censées être anonymisées, le risque de désanonymisation n’est jamais nul.

Un modèle d’IA générative, par sa capacité à mémoriser des fragments de données d’entraînement, pourrait accidentellement révéler des informations confidentielles sur un patient. C’est un risque de fuite de données d’un nouveau genre, qui pourrait compromettre la vie privée des patients.

Consentement éclairé

L’utilisation des données de santé pour l’entraînement d’une IA générative pose la question du consentement éclairé. Les patients sont-ils pleinement informés de la manière dont leurs informations sont utilisées ? Le consentement doit être non seulement explicite, mais aussi compréhensible pour le patient. Il est crucial pour les institutions de santé de s’assurer qu’elles respectent l’autonomie du patient.

Biais algorithmiques

L’IA est le reflet des données qui l’ont construite. Si l’IA est entraînée sur des jeux de données de patients majoritairement issus d’un certain groupe démographique, elle pourrait moins bien fonctionner pour d’autres populations. Ce biais algorithmique risque d’exacerber les inégalités en matière de santé, en rendant l’IA moins performante pour des communautés déjà sous-représentées.

Responsabilité légale

En cas d’erreur causée par une IA, la question de la responsabilité est complexe. Qui est responsable ? Le développeur de l’IA ? L’institution médicale qui a acheté l’outil ? Le médecin qui a utilisé la recommandation de l’IA ? Les lois et réglementations actuelles ont du mal à suivre le rythme de cette technologie, ce qui crée un vide juridique qu’il faudra combler.

Risques liés à la sécurité et à la qualité des données

Sécurité des données

Les plateformes d’IA générative sont des cibles de choix pour les cyberattaques. Une violation de données sur un serveur d’IA pourrait exposer les informations de milliers de patients. De plus, il existe des risques d’empoisonnement des données (data poisoning), où des données malveillantes sont insérées dans le jeu d’entraînement, compromettant le fonctionnement du modèle et menant à des résultats incorrects.

Qualité des données

La qualité des résultats d’une IA est directement liée à celle des données qui ont servi à son entraînement. Des données de santé incomplètes, inexactes ou mal formatées peuvent conduire à des modèles qui génèrent des informations erronées ou des diagnostics inexacts, ce qui représente un risque direct pour la sécurité des patients.

Risques médicaux et cliniques

Hallucination de l’IA

Les modèles d’IA générative peuvent parfois produire des informations qui semblent plausibles mais qui sont en réalité totalement fausses. C’est ce qu’on appelle les “hallucinations” de l’IA. Dans le contexte médical, une hallucination pourrait se traduire par un diagnostic incorrect, un plan de traitement inapproprié ou la référence à des études scientifiques qui n’existent pas. Cela peut mettre en danger la vie des patients.

Biais de confirmation et d’automatisation

L’IA ne doit pas remplacer le jugement clinique, mais le compléter. Il est facile de tomber dans le biais d’automatisation, acceptant sans esprit critique les recommandations de l’IA, même si elles sont erronées.

Absence de contexte relationnel

L’IA ne peut pas prendre en compte les aspects non-verbaux, les émotions et le contexte psychosocial du patient. Ces éléments sont pourtant fondamentaux pour établir un diagnostic précis et un plan de traitement adapté.

L’IA générative offre un potentiel énorme pour améliorer les soins de santé. Cependant, son déploiement ne peut se faire sans une évaluation rigoureuse de ses risques. Pour les DSI et les professionnels de santé, il est essentiel d’adopter une approche proactive pour mitiger ces risques, en mettant en place des stratégies claires de gouvernance, de sécurité des données et de formation du personnel. C’est à ce prix que l’IA deviendra un véritable partenaire, et non un risque pour le secteur de la santé.